Weiterentwicklungen, Neues, Vielversprechendes zum Thema Visualisierung

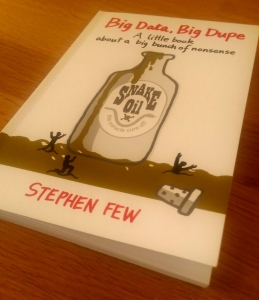

Der ganze Titel des Buches von Stephen Few lautet:

Big Data, Big Dupe – A little book about a big bunch of nonsense

Es wurde und wird viel geschrieben, geredet über Big Data in den letzten Jahren. Und es fließt noch mehr Geld für große Hoffnungen und vage formulierte Möglichkeiten. Da kommt dieses kleine Buch – erschienen im Februar 2018 – von Stephen Few gerade recht. Flüssig zu lesen, räumt es mit Irrtümern auf die heute im Zusammenhang mit großen Datenmengen so gern gebraucht werden:

- Große Datenmengen führen nur aufgrund ihrer Menge zu mehr Information.

- Es zählt die Korrelation, Kausalitäten sind zu vernachlässigen.

- Statistische Stichproben sind durch die große Datenmenge hinfällig.

- Wir sollten alles messen, denn wir haben von allem Daten und noch einige Irrtümer mehr …

Das Spannende dieses Textes liegt in der Art und Weise, wie diese Irrtümer aufgedeckt werden. Few bezieht seine Argumente auf Originalaussagen von Experten, zitiert Wissenschaftler und hinterfragt eine ganze Branche anhand konkreter Aussagen.

Fazit

Kurz: Lesenswert!!!

Etwas länger: Es ist kein klar strukturiertes Fachbuch, welches man durcharbeiten muss. Im Gegenteil es unterhält und liefert durch viele Querverweise, Linktipps und Hinweise interessante Denkanstöße. Für jene, die tief in der Materie stecken, ist es vielleicht zu wenig detailliert, bleiben zu viele Fragen offen. Aber es hilft beim Wachbleiben für das Thema. Es räumt auf unterhaltsame Art mit Big Data Nonsens auf. Die Hoffnung von Stephen Few ist, dass etwas Kleines, wenn es die Wahrheit sagt, etwas Großes entlarven und enttarnen kann. In diesem Sinne erfüllt dieses kleine Format seinen Zweck und ist empfehlenswert.

Für Interessierte

| Titel | Big Data, Big Dupe |

| Untertitel | A little book about a big bunch of nonsense |

| Herausgeber | Stephen Few |

| Auflage | erschienen 01. Februar 2018 (erhältlich in englischer Sprache) |

| Seiten | 96 |

| Verlag | Analytics Press, New Jersey |

| Preis | ca. 10 $ je nach Anbieter |

| ISBN | Print: 978-1-938377-10-5 (Hardcover); E-Book: 978-1-118-85841-7 |

Wer noch mehr von dem Autoren lesen möchte: https://www.perceptualedge.com/blog/

Controlling analysiert, plant und informiert Entscheider in Unternehmen. Das erfordert eine verlässliche Datenbasis, aber auch Flexibilität bei der Gestaltung von Berichten, Präsentationen und Dashboards. Diese Anforderungen lassen sich oft nicht in einem Softwaresystem vereinen. Die Diskussion über die Berechtigung lokaler Reporting Lösungen, welche zentrale Standardsysteme gezielt ergänzen, ist sehr aktuell. Der Beitrag berichtet aus der Praxis und vermittelt die Vor- und Nachteile lokaler Lösungen.

Zentrale versus lokale Reports

Als ich `lokale Reportlösungen´ in meinen Rechner schrieb, konnte ich die Aufforderung „think big or go home“ schon sinnbildlich hören. Schnell betrachtet, sieht es so aus, als fokussiere sich die Controlling Branche auf Big Data und die eine große BI-Lösung. Doch wie sieht es im Controlling wirklich aus? Welche Erfahrungen machen wir in unseren Projekten?

Die Utopie des einen Systems, in welches alle Daten fließen und aus dem sich auf schnellem Weg verschiedenste Reports zur Steuerung des gesamten Unternehmens generieren lassen, ist Antrieb für viele positive, wichtige Entwicklungen. Doch der Ressourcenaufwand hinter dieser Idee ist enorm. Praktikabel wird diese Art des Berichtswesens durch eine hohe Standardisierung und Kontinuität. Die Datensammlung und -speicherung profitiert von den Rahmenbedingungen.

Doch die Berichte und Präsentationen, die zentrale Systeme liefern, werden durch diese Bedingungen eingeschränkt. Sie sind wenig variabel und können nur begrenzt bei der Beantwortung nicht-standardisierter Fragestellungen helfen.

Automatisierte, lokale Reporting-Tools können diese Kommunikationshürden überwinden.

Sie sind daher eine flexible und kostengünstige Alternative. Aus unseren Projekten wissen wir, ein Mix aus zentralen und lokalen Berichtslösungen ist die bewährte Praxis.

Die lokale Reporting Lösung ist gar nicht so lokal

Es ist an dieser Stelle wichtig, die Controlling-IT aufzuteilen. Die Themen Datensammlung und -speicherung sind von der Kommunikation der Ergebnisse, der Reporterstellung zu trennen. Daten in Insellösungen zu erfassen, ist aus vielen Gründen zu hinterfragen. Jeder BI-Anbieter kann diese umfassend benennen. Für die Erstellung von Reports und Präsentationen lösen automatisierte Reporting-Tools auf lokaler Ebene jedoch eine Menge Probleme.

Genau genommen sind lokale Berichtswerkzeuge Hybriden. Die Daten, auf welche sie zugreifen, kommen in der Regel aus zentralen Systemen. Doch die Berichtserstellung erfolgt in Frontend-Tools, die individuell konzipiert wurden und lokal verwaltet werden. Die Verteilung der Reports kann ebenfalls automatisiert werden und unterliegt keinen besonderen Einschränkungen.

Der richtige Zeitpunkt für individuelle Reporting-Tools

Individuelle Berichts-Tools nützen, wenn das Management häufig wechselnde Berichtsvarianten benötigt. Sie sind sinnvoll, wenn strukturierte Daten aus dem DataWarehouse mit unstrukturierten, individuellen Kommentaren und Erläuterungen ergänzt werden sollen.

Im strategischen Controlling sind variable Berichts- und Präsentationswerkzeuge auf jeden Fall sinnvoll. Doch auch im operativen Controlling häufen sich Fragenstellungen, die von zentralen Berichten nur teilweise beantwortet werden können.

Anforderungen und Ressourcenbedarf

Einen Haken hat die Sache. Lokal erzeugte Reports sind in der Regel nicht mal eben schnell gemacht, frei nach dem Motto: „Die Daten haben Sie ja eh da.“ Der effizienten Erstellung lokaler Reporting-Tools geht in der Regel eine sehr lange Lernphase voraus.

In der Konzeption und Planung sind weniger Abstimmungen und Kompromisse zwischen Berichtsersteller und Berichtsempfänger notwendig. Das ist positiv. Doch die technische und gestalterische Umsetzung erfordert viel Know-how. Es sind Fachkenntnisse notwendig, die mit Controlling im betriebswirtschaftlichen Sinn nur noch wenig gemein haben.

Kenntnisse in der Datenanbindung, Automatisierung und Programmierung sind wesentlich. Soll die visuelle Darstellung und Präsentation effizient sein und hohen Qualitätsansprüchen genügen, ist mehr als durchschnittliches Anwenderwissen notwendig.

Eine Idee, wenn eigene Ressourcen fehlen

Doch auch ohne eigenen Ressourcenpool lassen sich die Vorteile lokaler Reporting-Tools leicht nutzen. Die Entwicklung solcher Werkzeuge ist eine individuelle Dienstleistung, für die es unterschiedliche Lösungsanbieter am Markt gibt. In der Regel sind das keine Softwareanbieter, sondern erfahrene Dienstleister mit speziellem Controlling-Know-how und einschlägigen Erfahrungen im Bereich Reporting.

Gute Dienstleister liefern Ihnen einen sehr hohen Qualitätsstandard, der ihren individuellen konzeptionellen und technischen Anforderungen entspricht.

Dabei arbeiten Sie in überschaubaren Projektzeiträumen direkt mit den Fachabteilungen und liefern sofort einsatzbereite Lösungen.

chartisan ist einer dieser Lösungsanbieter. Unser Fokus ist das Management Information Design mit IBCS® und die technische Umsetzung mit den Möglichkeiten von Microsoft Office (Excel, PowerPivot, Power Query, PowerPoint) und Power BI.

Vor- und Nachteile lokaler Reporting-Tools auf einen Blick

Sie haben wenig Zeit? Deshalb an dieser Stelle eine übersichtliche Plus-Minus-Liste:

+ Lokale Reporting-Tools erlauben variable Berichte und Präsentationen.

+ Sie können strukturierte und unstrukturierte Daten effizient darstellen.

+ Lokale Berichtswerkzeuge sind innerhalb kürzester Zeit einsatzbereit.

+ Durch ihre hohe Automatisierung unterstützen sie den operativen Controlling-Alltag.

+ Sie können passende Lösungen, als gezielte Ergänzung der Standardsysteme, extern kaufen.

– Durch die interne Entwicklung binden Sie wichtige Ressourcen, zeitlich und finanziell.

– Beim Einsatz externer Dienstleister kaufen Sie fremde Kompetenzen.

– Externe Dienstleistung kostet auch Geld.

Sind noch Fragen offen? Brauchen Sie noch einen Hinweis? Gern können Sie hier einen Kommentar hinterlassen oder sich vertraulich mit einer E-Mail melden.

Happy Reporting,

Ihre Silja Wolff

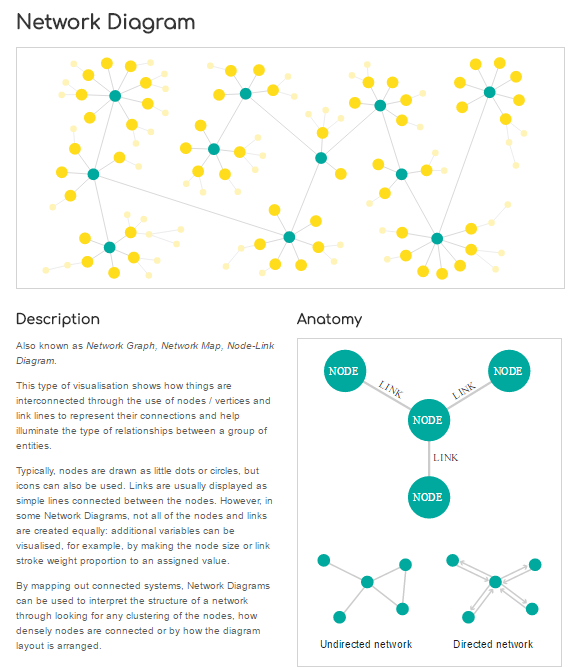

Datenvisualisierung im allgemeinen bedeutet, abstrakte Daten und Zusammenhänge in eine visuell erfassbare Form zu bringen. Soweit so gut, doch welche Darstellungsformen gibt es außer den mir bekannten noch, wann wende ich diese an und wann sind andere Formen sinnvoller. All jenen, die sich diese Fragen auch immer mal wieder stellen, möchte ich das Projekt von Severino Ribecca vorstellen:

www.datavizcatalogue.com

Dieser Online-Katalog ist eine Bibliothek verschiedener Informationsvisualisierungstypen. Anfänglich diente das Projekt Ribecca zur Erweiterung des eigenen Wissens über Datenvisualisierung und als Werkzeug für die eigene Arbeit.

Er schreibt selbst über das Projekt: „However, I felt it would also be beneficial to both designers and also anyone in a field that requires the use of data visualisation. Although there have been a few attempts in the past to catalogue some of the established data visualisation methods, there is no website that is really comprehensive, detailed or helps you decide the right method for your needs.“

Und glücklicherweise versteckt Severino Ribecca das Wissen nicht, gleich auf der Startseite ist man mittendrin:

Neben dem ersten Überblick ist die Möglichkeit „Search by Function“ für Praktiker besonders reizvoll. Auch hier setzt der Initiator wieder auf eine schnell zu erfassende Bildsprache:

Sobald Sie auf einen Icon klicken, erhalten Sie ein gut recherchiertes und aufbereitetes Wissen über den gewählten Visualisierungstyp. Jedes Darstellungsform wird mit ihrer Funktionsweise und Anwendungsmöglichkeiten dargestellt und mit Dummy-Daten visualisiert. Am unteren Ende der Beschreibung findet der Leser auch noch Hinweise auf ähnliche Darstellungsformen:

Es sind also maximal drei gut strukturierte Klicks bis zum Wissen um einzelne Visualisierungsformen. Ich finde dieses Projekt optisch und inhaltlich sehr gelungen, um einen Überblick zu erlangen. Vielleicht verhilft Ihnen dieser Tipp zu der einen oder anderen Inspiration für Ihre Informationsvisualisierungen?

Auf jeden Fall wünsche ich Ihnen Happy Reporting 🙂

Ihre Silja Wolff

Allen die sich täglich mit Informationsbereitstellung beschäftigen, ist es in der Regel bekannt: Es gibt einen wesentlichen Unterschied zwischen Informationsbedarf und Informationsbedürfnis. Welcher Anspruch bis hin zum Konfliktpotenzial sich daraus ergibt, wird schon seltener reflektiert.

Der Informationsbedarf ergibt sich aus der objektiven Beurteilung, welche Informationen für die Aufgabenerfüllung notwendig sind. Das Informationsbedürfnis ist die subjektive Beurteilung des Einzelnen, welche Informationen er meint für die Aufgabenstellung zu benötigen.

Im Allgemeinen ist das Informationsbedürfnis deutlich größer als der Informationsbedarf. Als Informationslieferant sind sie daher gezwungen die Balance zwischen beiden zu finden.

Das Wissen, welcher objektive Informationsbedarf befriedigt werden soll, ist in den Organisation allermeist vorhanden. Informationslieferanten und Empfänger haben hier klare Erwartungen aneinander.

Denken Sie z.B. an das Standardberichtswesen eines Unternehmens. Die Ermittlung des Informationsbedarfs ist eine zyklische Daueraufgabe. Folgende Fragen können Sie dabei unterstützen:

- Inhaltlich: Welche Informationen sind notwendig?

- Häufigkeit: Wie oft wird die Information benötigt?

- Form: In welcher Form ist die Information am sinnvollsten?

- Medium: Wie wird die Information veröffentlicht?

- Priorisierung: Wie relevant ist die Information für die Aufgabenerfüllung?

Weniger klar ist das Prozedere, wenn es um das Bedürfnis des Einzelnen geht. Denn das Informationsbedürfnis des Empfängers ist geprägt von unterschiedlichen Faktoren. Das bewusste und teils auch unbewusste Zusammenspiel individueller Persönlichkeitsmerkmale und Organisationsabhängiger Faktoren bildet den Bedürfniskern. In der Praxis kann man häufig einen Zusammenhang zwischen „empfundenen unsicheren Zeiten“ und einem gesteigerten Informationsbedürfnis beobachten.

Es gibt nur einen Weg das Informationsbedürfnis zu erfassen – stellen Sie Fragen und hören Sie bei den Antworten genau zu. Jetzt ist es ihre Aufgabe als Informationsersteller angemessene Informationen bereit zu stellen.

Das heißt der Aufwand der Informationsbeschaffung steht im ausgewogenen Verhältnis zum Informationsbedürfnis des Empfängers.

Als Ersteller von Informationen ist es notwendig die Zeit und die Kosten der Informationsbeschaffung neutral einschätzen und benennen zu können. Denn es ist ihre Spielfeldbegrenzung, ihr Verhandlungsrahmen gegenüber ausufernden Informationsbedürfnissen. Am Ende bleibt: ´Beim Reden kommen die Leute zusammen.`

Ich wünsche Ihnen Happy Reporting, Ihre Silja Wolff.

Ein innerer Dialog in mehreren Teilen, der begann als ein potentieller Kunde anrief und sein Anliegen so formulierte: „Wir wünschen uns einen Workshop über den Einsatz verschiedener Design Thinking Ansätze bei der Präsentation von Unternehmensdaten.“

A: Ist das nicht Elefanten auf Mücken werfen? Design Thinking und Datenvisualisierung, stimmt die Relation?

B: Kommt drauf an, z.B. wie man Design Thinking definiert und aus welcher Perspektive man Datenvisualisierung betrachtet. Nimmt man Design Thinking als einen Innovationsprozess, der den Kunden und seine Bedürfnisse in den Fokus rückt und die visualisierten Reports als Produkt bzw. Dienstleistung für einen (internen) Kunden sieht, gibt es zumindest schon mal eine Schnittfläche.

A: Ist für einen erfolgreichen Einsatz der Methode nicht mehr nötig als nur das Durchlaufen der Schritte?

B: Ja. Konsequent gedacht, hinterfragt man die vorhandene Kultur. Grundsätzlich braucht es die Bereitschaft zum Neudenken und eine nur grob planbare Verfügbarkeit verschiedenster Ressourcen. Neben dem täglichen operativen Geschäft wird es nicht gut gehen.

A: Vielleicht doch Konzentration auf das Nötige und nicht der große, „gerade vom Zeitgeist gebeutelte“ Design Thinking Ansatz für ein paar Seiten Bericht?

B: Zumindest in der Theorie lässt sich der Prozess kurz formulieren: Design Thinking ist ein offen und interdisziplinär gestalteter Iterationsprozess, der sich in fünf grobe Schritte gliedern lässt:

- tief in das Thema eintauchen, beobachten wie sich Nutzer verhalten, in die Rolle des Kunden schlüpfen und spüren, wie es einem mit der Dienstleistung, dem Produkt ergeht

- es wurde in Schritt 1 so viel Wissen gesammelt (auch zwischen den Zeilen), dass es möglich ist, das Problem konkret zu benennen und sich darauf zu fokussieren

- jetzt mit Kreativität zur Lösungsfindung durchstarten – alles darf gedacht werden, was hilft die Hürde zu nehmen

- mit einfachen Mitteln einen Prototypen erstellen

- diesen Prototypen am Kunden testen, Feedback einholen und bei Änderungswünschen genau hinhören… nein – nicht verkaufen, den je nach Lernergebnis können, dürfen, müssen Schritte wiederholt werden.

A: Die Prozess-Sicht verengt aber die Perspektive auf das, was möglich wäre.

B: Das ist richtig. Doch die Eingangsbitte dreht sich ja um den Einsatz von Design Thinking bei der Präsentation von Unternehmensdaten.

A: Die Bitte führt dazu, dass es nicht um das „Wie“ der Präsentation geht sondern um das „Was“, um den Inhalt. Zur Inhaltsbestimmung von Reports, zur Beantwortung von Fragen nach Entwicklungen, die vielleicht übersehen wurden oder der Qualität von Beobachtungsrastern, der Kundenperspektive in vorhandenen Kennzahlensystemen lässt sich die Methode gut nutzen.

B: Doch ehrlich, wie viele Controller und Entscheider kenne ich in der Praxis, die noch freie Kapazitäten für solch aufwändigen Prozess haben?

A: Also bleibt alles wie immer? Das kann es ja auch nicht sein…

B: In der Praxis läuft es doch so, wenn sich Organisationen für Design Thinking in umfassender Form zur Entwicklung, Verbesserung von Dienstleistungen und Produkten für externe Kunden entscheiden, dann ändert sich fast zwangsläufig auch das Reporting. Und in kleiner, fein abgestimmter Form wird die Methode genutzt für das Design oder Re-Design von Berichten, als praktikabler Weg zwischen Möglichem und Nötigem…

Interessierte können hier weiterlesen und mehr erfahren:

Informativer Blog zum Thema Design Thinking, der viele Einblicke und wissenswerte Erfahrungen vermittelt: http://www.designthinkingblog.com/

Alle, die sich zum Thema austauschen möchten, sind hier richtig: http://www.designthinkingnetwork.com/

Der Herbst ist eine gute Zeit nach neuen Büchern Ausschau zu halten. Im September diesen Jahres erschienen ist das Buch „1+1≠2“ von Veruschka Götz und Anna Rigamonti. Der Untertitel „Informationsvisualisierung – Missbrauch und Möglichkeiten“ weist die Richtung.

Die Autorinnen sind (Grafik-)Designerinnen und nähern sich dem Thema Visualisierung aus gestalterischer Sicht. Da ich mich, wie in meinem Blogbeiträgen häufiger durchblitzt, einige Jahre mit Grafikdesign beschäftigt habe, ist mir die Perspektive der Schreiberinnen sehr vertraut. Trotz der Vertrautheit mit dem Thema hat mich das Buch überrascht und begeistert.

„Informationsdesign kann Inhalte und Meinungen beeinflussen, verfälschen und manipulieren.“

Doch dieses Buch ist mehr als ein Verriss falscher Informationsgrafiken. Es liefert in 4 Teilen praxistaugliches Grundlagenwissen. Im ersten Teil wird übersichtlich die Geschichte der Datengrafik beschrieben. Interessant lesen sich die Entstehungszeiten der verschiedenen Diagrammtypen. (Kurz gefasst: Alles schon dagewesen.)

Der mittlere Abschnitt ist untergliedert in einen Grundlagenteil zur Statistik, Recherche und Struktur und in einen Basisteil Gestaltung. Eine sehr übersichtliche Beschreibung von Funktion und Form unterschiedlicher Diagrammtypologien eröffnet Teil 3. Hier haben die Schreiberinnen fundiert alle Diagrammtypen und deren Anwendung beschrieben und in vielen Beispielen visualisiert.

Der letzte Teil ist dem Missbrauch von Informationsgrafiken gewidmet. Auch hier findet der Leser sehr gute Beispiele und Beschreibungen, worin konkret die Manipulation besteht. Informationsvisualisierung wird beschleunigt durch die allgegenwärtige Digitalisierung. Die Designerinnen tragen diesem Umstand Rechnung und äußern sich am Ende des Buches zu verschiedenen Navigationstypologien und digitaler Manipulation.

Die Grafik zum Thema „Übergewicht durch zu günstige Kinotickets“ ist mein persönlicher Favorit für die Absurditäten-Charts der Infografiken. 🙂

Fazit

Das Buch empfiehlt sich einer breiten Leserschaft. Nutzer von Informationsvisualisierungen (das sind wir ja fast alle) können unterhaltsam ihren kritischen Sachverstand schärfen. Ersteller von Visualisierungen von Daten und Informationen erhalten übersichtlich und praxistauglich konkrete Arbeitshinweise. Die thematische Bandbreite und das fundierte Fachwissen machen das Buch für den Einsteiger ebenso lesenswert wie für den fortgeschrittenen Informationsvisualisierer.

Die Autorinnen schreiben „der Informationsdesigner darf nicht dem Reiz der Ästhetik verfallen, er sollte die Form vom Inhalt ableiten.“ Das Buch ist ein gelungenes Beispiel für die Umsetzung dieses hohen Anspruchs.

Für Interessierte

| Titel | 1+1≠2 |

| Untertitel | Informationsvisualisierung – Missbrauch und Möglichkeiten |

| Herausgeber | Veruschka Götz, Anna Rigamonti |

| Auflage | September 2015 |

| Seiten | 168 |

| Verlag | av edition GmbH, Verlag für Architektur und Design, www.avedition.de |

| Preis | 28,00 € |

| ISBN | 978-3-89986-228-7 |

Die Anforderungen an das unternehmensinterne Reporting wachsen stetig. Das Mehr an zur Verfügung stehenden Informationen spiegelt sich in der Effizienzerwartung an die Berichte. chartisan ist in viele Re-Design Projekte eingebunden. Dabei sind manchmal unkonventionelle Ideen zur Projektinitiierung gefragt.

Das Reporting vieler Unternehmen steht auf dem Prüfstand. Das Hauptaugenmerk der Verantwortlichen aus IT und Controlling konzentriert sich zuerst auf die wachsende Datenmenge und Datenstruktur. BI-Lösungen werden implementiert und liefern immer mehr Informationen für Entscheidungsträger. Im Zuge dieser Umstrukturierungen ist es oft notwendig das Report-Design ebenfalls zu überdenken. Letztlich stehen zwar mehr Informationen zur Verfügung, nicht aber mehr Zeit für die Entscheider diese auch zu verarbeiten. Effizienter Informationsgewinn ist das Ziel.

In einem ressourcen-kritischen Umfeld wie Controlling braucht es manchmal unkonventionelle Ideen, um die Bereitschaft für den Re-Design Prozess zu wecken. Neben den klassischen Beratungsansätzen, hier zwei Varianten aus unserer Ideen-Box, die jeder anwenden kann:

Idee 1: Report-Expedition

Die Teilnehmer von Re-Design Prozessen sind oft eng mit „ihren Reports“ vertraut. Das eigentliche Ziel der Reports – effiziente Informationsgewinnung – gerät durch diese Vertrautheit aus dem primären Fokus.

Während der Report-Expedition begeben sich die Beteiligten „in die Welt von Berichtsempfängern“.

Sie erkunden, welche guten und schlechten Berichte sie erleben.

Das Ganze funktioniert relativ simpel. Die Teilnehmer bekommen die Aufgabe ansprechende oder negative Beispiele von Berichten und Berichtspräsentationen zu finden. Die meisten Menschen werden innerhalb kürzester Zeit sehr erfindungsreich, wenn es darum geht Beispiele zu entdecken. Die positiven und negativen Gemeinsamkeiten der Beispiele gilt es kurz zu dokumentieren. Es reichen Skribbel, Stichpunkte, Screenshots.

Report-Expeditionen sind eine einfache Möglichkeit mit den Augen von Berichtsempfängern zu sehen. Das Verständnis für die Bedürfnisse der Leser wächst und erleichtert so den anstehenden Re-Design Prozess.

Idee 2: Marschroute der Leser

Erreichen die Berichte ihren Zweck? Fragen die Ersteller direkt beim Leser nach, erhalten sie aus den verschiedensten Gründen oft nur halbe Antworten. Man kennt sich und ist nett zueinander, man hat gerade wenig Zeit oder der Berichtsempfänger nimmt die Qualität als gegeben hin.

Die Chance dieser Idee steckt in dem Abstand zwischen Leser und Empfänger.

Der Berichtsempfänger markiert, ohne dass der Ersteller persönlich anwesend ist, direkt auf der Berichtsseite mit Kringeln, Priorisierungen oder ähnlich kurzem Feedback die Reihenfolge der Wahrnehmung. Der Berichtersteller erhält so den Überblick, welche Information für den Leser besonders wertvoll war oder welche Informationen in diesem Zusammenhang zu detailliert oder gar überflüssig waren.

Anhand mehrerer gesammelter Marschrouten von unterschiedlichen Lesern gelingt es den Projektteilnehmern nun leicht, Detailebenen und Zielgruppen zu bestimmen. Der Re-Design Prozess startet so direkt mit den Bedürfnissen der Zielgruppe.

Diese beiden Ideen sind aus dem Design von Service-Prozessen abgeleitet und weitergedacht. Durch den unkonventionellen Ansatz gewinnt man pragmatisch Ansatzpunkte zur Verbesserung der individuellen Report-Visualisierungen. Sie sind leicht umzusetzen und liefern den Berichterstellern eine Möglichkeit die Qualität ihrer Berichte zu testen.

Probieren Sie es aus, die Ergebnisse werden Sie hoffentlich positiv überraschen!

Der Ursprung der Portfolios liegt in der Finanzwirtschaft und bezeichnet eine Planungsmethode zur Zusammenstellung eines Wertpapierpakets (Portefeuille) nach den Kriterien Rendite und Risiko. Diese Methode wurde später, in den 70er Jahren, auf andere Bereiche übertragen. Seit dieser Zeit wurde die Portfolio-Analyse vielfach modifiziert und zählt heute zu den verbreitetsten Analyse- und Planungsinstrumenten des strategischen Managements. Die Grundidee jedes Portfolios ist die Segmentierung und Bewertung einer Datenmenge.

Grundlagen der Darstellung

Die meisten Portfolios sind zwei- oder dreidimensional dargestellt. Bei dreidimensionalen Abbildungen ist die Punktgröße die dritte Werteperspektive neben den beiden Achsen. Seltener sieht man vierdimensionale Portfolios, hierbei werden die Blasen neben ihrer werteabhängigen Größe weiter als Kreisdiagramme segmentiert.

Basisanforderung an alle Darstellungen ist – wie immer – die effiziente Lesbarkeit. Das gelingt durch eine schnell zu erfassende visuelle Wertung von Daten, etwa durch das Einfärben von Blasen oder das Verwenden verschiedener Symbole. Auch eingezeichnete Segmentierungskriterien, z.B. Linien, unterstützen das Erfassen.

Skalierung und Wertintervalle

Anders als bei den üblichen Säulen-, Balken- und Abweichungsdiagrammen müssen die Skalen nicht notwendigerweise bei Null anfangen.

Eine bewusste Wahl der Wertintervalle ist notwendig, wenn die Segmentierung sinnvoll dargestellt werden soll.

Sinnvoll heißt in diesem Zusammenhang alle Punkte sind sichtbar und verschwenden gleichzeitig keinen Platz.

Je häufiger ein Portfolio mit unterschiedlichen Datensätzen angewendet wird, desto wichtiger ist die bewusste Wahl der Skalierung. Ein Hinweis: Oftmals ist hier auch ein Verändern der Softwareautomatik notwendig, so fangen automatische Portfolio-Achsen in Excel stets bei Null an. Eher ungünstig, wenn sich Ihre Daten alle zwischen den Werten 350 und 480 tummeln.

Legenden und Beschriftungen

Besonderes Augenmerk ist auch auf das Thema Legenden und Beschriftungen zu legen. Beschriften Sie direkt an den entsprechenden Diagrammbestandteilen, das erhöht die Lesbarkeit direkt. Entscheiden Sie sich für ein dreidimensionales Portfolio, sind die Werte direkt an die Blasen zu schreiben, da hierfür keine Skala vorgesehen ist.

Portfolios sind aus dem strategischen Management nicht mehr fortzudenken. Jede Wertung, jeder Portfolio-Ansatz enthält Stärken und Schwächen. Doch unabhängig von der Art und Struktur jedes Portfolios ist die Visualisierung entscheidend für den nützlichen Einsatz dieses Analysetools. Die oben genannten allgemein gültigen Kriterien sind ein guter Rahmen für jede Portfolio-Darstellung.

Im letzten Blogartikel habe ich es angekündigt. Hier also mein Eindruck der druckfrischen Ausgabe von Stephen Fews neuem Buch:

„Bessere Entscheidungen können nur durch besseres Verständnis kommen. Informationstechnologien sind nicht der Schlüssel zu besseren Entscheidungen, das sind wir. Technologien können unser Denken erweitern, aber nicht ersetzen.

Computer haben ein neues „Datenzeitalter“ eingeläutet. Das „Informationszeitalter“ wird erst noch kommen. Wichtiger als das Sammeln von Daten ist es, das wir lernen Signale vom Rauschen zu unterscheiden.“ (Auszug) So fasst der Autor selbst den Inhalt des Buches auf der Rückseite zusammen.

Nach seinem letzten Buch „Information Dashboard Design“ beschäftigt sich Stephen Few jetzt mit der Grundlage guter Visualisierung, den Inhalten. Wie kommen wir zu guten Inhalten? Wie erkennen wir aus einer Fülle von Daten jene, die Entscheidungsrelevant sind?

Warum wäre eine „Slow data-Bewegung“ ganz nützlich?

Stephen Few teilt diesen Weg im Buch in zwei Hauptteile. Im ersten Teil geht es um Grundlagenwissen über Daten und Korrelationen. In einzelnen Kapiteln verbindet er bekannte statistische Aussagen mit betriebswirtschaftlichem Denken: Korrelationen von Kategorien, Maßnahmen; zeitliche Veränderungen; Zusammenhänge zwischen mehreren Variablen und Perspektiven. Die Darstellungen und ergänzenden Beispiele sind gewohnt einprägsam.

Als Begründung für das ausführliche Grundlagenkapitel nutzt Few ein Zitat von A. Lincoln: „Give me six hours to chop down a tree and I will spend the first four sharpening the axe.” Und fügt an:

„This is unpopular but sage advice.”

Der zweite, kürzere Teil des Buches liefert Ideen zum Installieren von Signalgebern, beschreibt wie durch Dokumentation eine nachhaltige Filterung des „Datenrausches“ nach Signale aussehen kann. Ergänzend hierzu finden sich am Ende des Buches zwei Praxisbeispiele.

Fazit

Edward Tufte fasste bereits 2006 die Erfahrung vieler in den Satz: „Design cannot rescue failed content.“ Das vorliegende Buch von Stephen Few beschäftigt sich auf gelungene Weise mit den Wurzeln guter Visualisierung.

Auf unterhaltsame, nicht aufdringliche Art vermittelt Stephen Few mit anschaulichen Beispielen eigentlich trockenes Statistikwissen. Inhaltlich sollte denjenigen, die sich täglich mit Datenanalyse beschäftigen, alles bekannt sein. Doch die gezogenen Vergleiche, Darstellungen und Fragen sind gut geeignet, das unternehmerische Denken zu schulen.

Nicht für jede statistische Korrelation besteht auch ein handlungsrelevanter, kausaler Zusammenhang. Um dies nicht zu vergessen, empfehle ich dieses Buch.

Für Interessierte

| Titel | Signal |

| Untertitel | Understanding What Matters in a World of Noise |

| Herausgeber | Stephen Few |

| Auflage | erschienen Juni 2015 |

| Seiten | 209 |

| Verlag | Analytics Press, www.analyticspress.com |

| Preis | 43,15 € |

| ISBN | 978-1-938377-05-1 |

Reporting Tools für Controlling und Management I chartisan

Die chartisan GmbH entwickelt individuelle Tools für Controller. Unser Fokus sind Lösungen für Visual Analytics, Datenvisualisierung und Report Automatisierung. Wir setzen auf die vorhandene IT-Struktur und liefern das fehlende Puzzleteil. Internationale Konzerne, mittelständische Unternehmen und öffentliche Verwaltungen sind unsere Kunden. Für sie nutzen wir Branchen unabhängig Erfahrungen aus Controlling, Management und IT.